فایل Robots.txt یکی از ابزارهای مهم در بهینهسازی موتور جستجو (SEO) است که به وبمستران اجازه میدهد کنترل روی بر نحوه دسترسی رباتهای جستجو به محتوای وبسایت خود داشته باشند. این فایل در ریشه دایرکتوری سایت قرار میگیرد و شامل دستورات خاصی است که مشخص میکند کدام بخشها از سایت میتوانند توسط رباتها خزیده شوند و کدام بخشها باید نادیده گرفته شوند. استفاده صحیح از این فایل میتواند به بهبود نمایهسازی و کاهش بار روی سرور کمک کند. در ادامه این مطلب به بررسی انواع، عملکرد و نحوه استفاده از این فایل میپردازیم.

فایل robots.txt چیست؟

با استفاده از robots.txt، میتوانید دستورات دقیقی به رباتهای موتور جستجو ارسال کنید، بهطوریکه بدانند کدام بخشهای سایت برای آنها قابل دسترسی است و کدام بخشها نباید بررسی شوند. این فایل در ریشه دایرکتوری وبسایت قرار میگیرد و معمولا بهصورت یک فایل متنی ساده با پسوند txt در نظر گرفته میشود.

این فایل از پروتکل Robots Exclusion Protocol پیروی میکند و میتواند دستورات خاصی برای محدود کردن یا آزاد کردن دسترسی رباتها به برخی بخشهای سایت ارائه دهد. به عنوان مثال، شما میتوانید به رباتها بگویید که از بررسی صفحات خاصی خودداری کنند یا فقط لینکهای موجود در صفحات را دنبال کنند.

نحوه عملکرد فایل robots.txt

فایل robots.txt برای چیست؟ این فایل به رباتهای جستجو دستور میدهد که کدام صفحات از سایت شما باید ایندکس شوند و کدام صفحات نباید توسط موتورهای جستجو بررسی شوند. در واقع، این ابزار به شما کمک میکند که از نحوه دسترسی رباتها به سایت خود آگاه باشید و آنها را به بهترین شکل هدایت کنید. در ادامه نحوه عملکرد این فایل را شرح میدهیم.

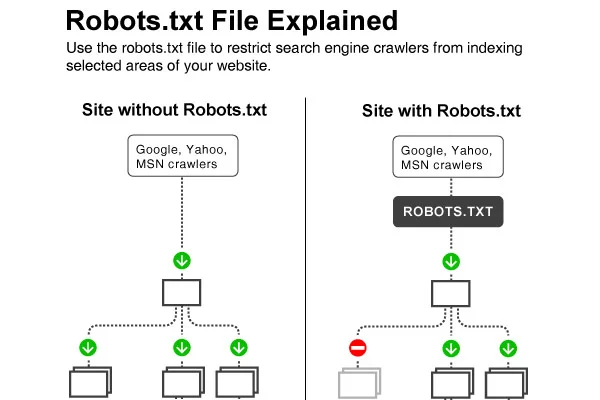

بررسی از طریق لینکها

رباتهای گوگل به طور معمول با دنبال کردن لینکهای موجود در صفحات سایت وارد میشوند و صفحات جدیدی که به آنها لینک داده شده را کشف و ایندکس میکنند. این روش ابتداییترین شیوه برای بررسی سایتها توسط رباتها است و بهنوعی هر صفحهای که لینک داخلی دریافت کند، شانس ایندکس شدن خواهد داشت.

عملکرد فایل robots.txt

درصورتیکه شما از تنظیم فایل robots txt استفاده کرده باشید، رباتهای گوگل قبل از اینکه وارد صفحات سایت شوند، ابتدا به سراغ فایل robots.txt میروند و دستورات موجود در آن را بررسی میکنند. شما میتوانید از این فایل برای مسدود کردن دسترسی رباتها به صفحات خاص یا هدایت آنها به بررسی قسمتهای خاصی از سایت استفاده کنید. در واقع، این فایل میتواند به شما این امکان را بدهد که کنترل کاملی روی نحوه دسترسی رباتها به سایت خود داشته باشید.

نحوه دسترسی به فایل robots.txt

فایل Robots.txt ابزاری حیاتی برای تنظیم نحوه دسترسی رباتها به سایت شما است. برای دسترسی به این فایل، چند روش مختلف وجود دارد که میتواند به شما در مدیریت بهتر سایت کمک کند. یکی از سادهترین روشها، استفاده از ابزارهای آنلاین و داشبوردهایی مانند گوگل سرچ کنسول است. شما میتوانید از طریق این ابزارها فایل robots.txt خود را مشاهده و تغییرات لازم را انجام دهید.

برای پیدا کردن این فایل، کافیست عبارت فایل robots.txt کجاست را در گوگل جستجو کنید. معمولا یکی از لینکها در نتایج جستجو به ابزار گوگل سرچ کنسول مربوط میشود که شما میتوانید از آنجا دسترسی لازم را به فایل robots.txt پیدا کنید. در این ابزار، شما میتوانید بهراحتی تنظیمات مربوط به دسترسی رباتها را مدیریت کرده و تغییرات دلخواهتان را اعمال کنید.

اهمیت استفاده از فایل robots.txt

با استفاده از فایل Robots.txt ، قادر خواهید بود تنظیمات دقیقی را برای ایندکس شدن و کراول کردن صفحات سایت اعمال کنید. در ادامه مهمترین دلایل استفاده از این فایل را توضیح میدهیم.

جلوگیری از کنیبالیزیشن

یکی از مزایای استفاده از فایل robots.txt جلوگیری از کنیبالیزیشن است. کنیبالیزیشن زمانی رخ میدهد که چندین صفحه مشابه در نتایج جستجو نمایش داده شوند و این میتواند باعث کاهش ترافیک و بازدید از صفحات سایت شما شود. با استفاده از این فایل، میتوانید به رباتهای گوگل دستور دهید تا صفحات تکراری را ایندکس نکنند و در نتیجه از بروز این مشکل جلوگیری کنید.

جلوگیری از ایندکس شدن فایلهای خاص در سایت شما

در برخی مواقع، ممکن است بخواهید فایلهایی نظیر PDF، تصاویر یا ویدئوها در نتایج جستجو نمایش داده نشوند. از طریق آموزش robots txt و تنظیمات این فایل، میتوانید به گوگل اعلام کنید که این فایلها را ایندکس نکند. این قابلیت مخصوصا برای سایتهایی که محتوای خاصی دارند و نمیخواهند آن محتوا در جستجوها نمایان شود، بسیار مفید است.

جلوگیری از نمایش برخی از محتواهای سایت شما

احتمالا برخی صفحات مانند درباره ما یا تماس با ما برای شما اهمیتی نداشته باشند که در نتایج جستجو نمایش داده شوند. شما میتوانید از طریق فایل robots.txt سایت این صفحات را از ایندکس شدن و نمایش در نتایج جستجو جلوگیری کنید.

مدیریت ترافیک رباتها

از طریق فایل robots.txt وردپرس میتوانید ترافیک رباتها را مدیریت کرده و از ارسال درخواستهای زیاد به سرور سایت جلوگیری کنید. این کار خصوصا برای سایتهایی با محدودیت منابع سرور میتواند بسیار مفید باشد. با تنظیم این فایل، میتوانید از بروز مشکلات مربوط به ترافیک رباتها جلوگیری کنید و صفحات مهمتری را در اولویت کراول قرار دهید.

انواع دستورات در فایل robots.txt

فایل Robots.txt ابزاری قدرتمند محسوب میشود که به شما این امکان را میدهد تا رفتار رباتهای موتور جستجو را در سایت خود کنترل کنید. این فایل با استفاده از دستورات مختلفی قابل تنظیم است که هرکدام کاربرد خاصی دارند. در این بخش به توضیح مهمترین دستورات موجود در این فایل خواهیم پرداخت که به شما کمک میکنند تا عملکرد سایت خود را بهینه کنید.

دستور User-agent

دستور User-agent به شما این امکان را میدهد که رفتار رباتهای خاص را مدیریت کنید. با استفاده از این دستور، میتوانید مشخص کنید که رباتهای موتور جستجو چگونه باید سایت شما را کراول کنند. اگر بخواهید یک ربات خاص را هدف قرار دهید، میتوانید نام آن را در دستور وارد کنید.

دستور Disallow

یکی از کاربردیترین دستورات در بهینه سازی فایل robots، دستور Disallow است که با استفاده از آن میتوانید از ایندکس شدن و کراول شدن صفحات خاص در سایت خود جلوگیری کنید. بهعنوانمثال، اگر نمیخواهید رباتها به صفحهای خاص دسترسی داشته باشند، میتوانید آن را در این دستور ذکر کنید.

دستور Allow

درصورتیکه شما از دستور Disallow برای جلوگیری از دسترسی به یک پوشه استفاده کردهاید، میتوانید از دستور Allow برای دادن دسترسی به یک فایل خاص در داخل همان پوشه استفاده کنید. این دستور به شما کمک میکند تا دقیقتر مدیریت کنید که کدام فایلها و صفحات در دسترس رباتها قرار گیرند.

دستور Sitemap یا نقشه سایت

با استفاده از دستور Sitemap در این فایل، میتوانید مسیر نقشه سایت خود را به رباتها معرفی کنید. این کار باعث میشود که موتورهای جستجو مانند گوگل و بینگ، بهراحتی به نقشه سایت شما دسترسی پیدا کنند و صفحات آن را بهدرستی ایندکس کنند.

دستور Crawl-delay

دستور Crawl-delay به شما این امکان را میدهد که مشخص کنید رباتها باید چند ثانیه پس از هر درخواست برای کراول کردن سایت شما صبر کنند. این دستور میتواند به شما در مدیریت ترافیک رباتها کمک کند و از بروز مشکلات در سرور سایت جلوگیری کند.

نحوه استفاده از فایل robots.txt

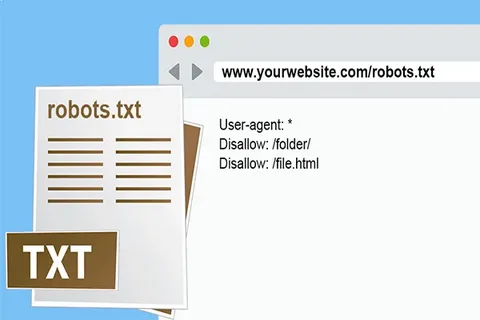

برای استفاده از فایل Robots.txt، ابتدا باید بدانید که دسترسی به این فایل بسیار ساده است. شما تنها با افزودن پسوند robots.txt به انتهای آدرس سایت خود میتوانید این فایل را مشاهده کنید. این فایل بهعنوان یک راهنما برای رباتهای موتور جستجو عمل میکند تا نحوه دسترسی و ایندکس کردن صفحات مختلف سایت شما را تعیین کنند. به این صورت، رباتها از دستورات موجود در این فایل پیروی میکنند و رفتار سایت شما را بر اساس آن تنظیم میکنند.

اگر قصد ویرایش فایل robots txt را دارید، باید به بخش Root یا همان دایرکتوری اصلی سایت خود مراجعه کنید. در این بخش، میتوانید این فایل را مشاهده کرده و تغییرات موردنظر را اعمال کنید. با این کار میتوانید دستورات خاصی مانند محدود کردن دسترسی رباتها به برخی صفحات یا فایلها را بهراحتی تنظیم کنید. این عملیات به شما این امکان را میدهد که کنترل بیشتری بر نحوه رفتار رباتها داشته باشید و سایت خود را برای موتورهای جستجو بهینهسازی کنید.

جمعبندی

در این مقاله به یک سوال خیلی مهم و فنی پاسخ دادیم؛ Robots txt چیست؟ این فایل یک ابزار مهم برای مدیریت نحوه دسترسی رباتهای موتور جستجو به صفحات مختلف سایت شما است. با استفاده از این فایل، میتوانید به رباتها دستور دهید که کدام صفحات را ایندکس کنند یا از ایندکس کردن کدام صفحات خودداری کنند. این فایل میتواند در بهبود سئو سایت، جلوگیری از ایندکس شدن صفحات تکراری یا حساس و همچنین مدیریت ترافیک رباتها موثر باشد. برای ویرایش یا مشاهده آن، تنها کافیست به بخش Root سایت خود مراجعه کرده و تغییرات لازم را اعمال کنید.

سوالات متداول

- فایل robots.txt چیست؟

فایل robots.txt یک فایل متنی است که به موتورهای جستجو دستور میدهد که کدام صفحات سایت را ایندکس کنند و کدام صفحات را نادیده بگیرند.

- چگونه به این فایل دسترسی پیدا کنیم؟

برای دسترسی به این فایل، کافی است آدرس سایت خود را با اضافه کردن / robots.txt در انتها وارد کنید.